| jjybzxw | 2026-02-22 11:51 |

|

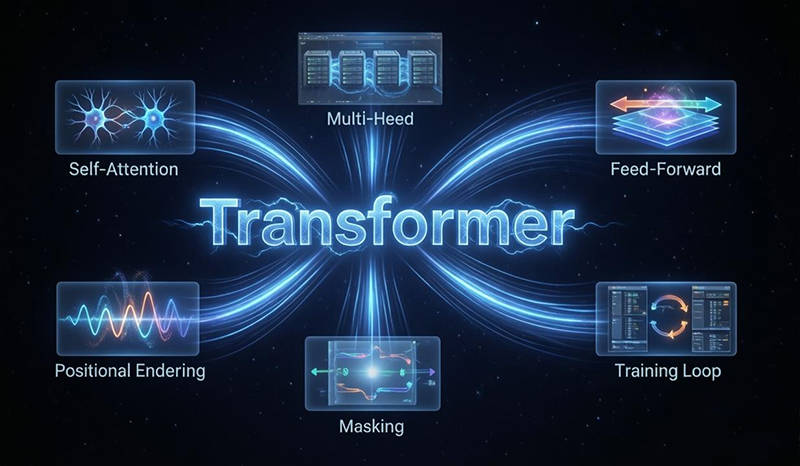

现在的AI大模型,对大家来说并不陌生,今天我们来聊聊AI大模型基石:Transformer。Transformer是2017年由谷歌团队提出的一种革命性神经网络架构,其核心创新在于摒弃了传统的循环神经网络(RNN),完全依赖“自注意力机制”来处理序列数据。 它解决了RNN难以并行计算和捕捉长距离依赖的瓶颈,能够一次性并行处理整个序列,极大地提升了训练效率和模型性能。其核心组件包括多头自注意力、位置编码、前馈神经网络以及残差连接等。

该架构由编码器和解码器两部分组成。编码器负责理解输入并生成上下文表示,解码器则自回归地生成输出。这一设计使其在机器翻译等序列到序列任务中表现出色。 Transformer的提出是自然语言处理领域的里程碑。它不仅是BERT、GPT等几乎所有现代大语言模型的技术基石,还被成功扩展到计算机视觉、语音识别等多个领域,成为当前AI大模型时代的核心引擎。 用一句大白话说就是: 传统 AI 是逐字念课文,Transformer 是一眼扫完整篇、直接抓意思。 |

|